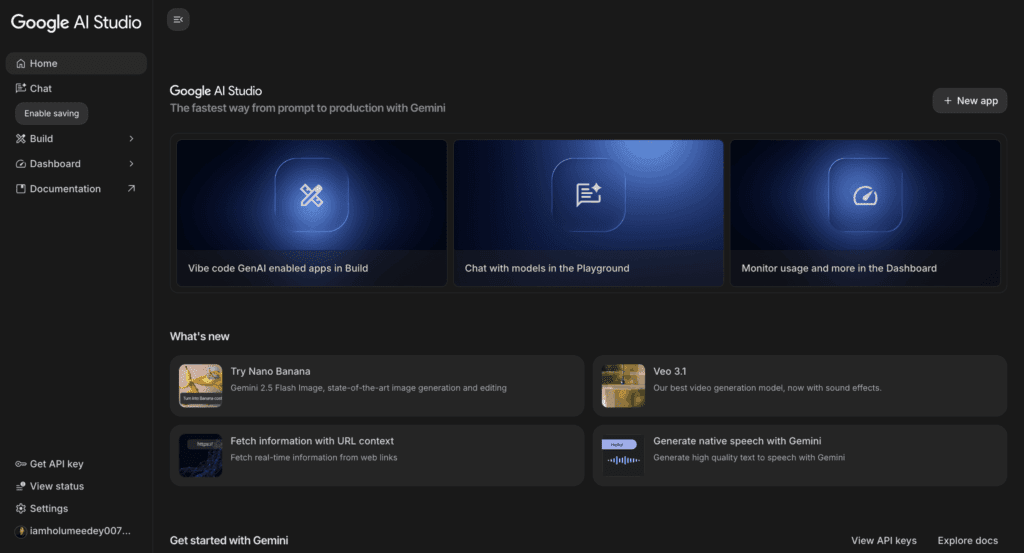

A Google AI Studio egy intuitív, böngészőből használható felület, amellyel a legújabb Gemini modellekkel lehet gyorsan prototipizálni, kísérletezni és éles kódot exportálni. A platform átláthatóan egyesíti a promptolást, a kimenetek elemzését és a fejlesztői integrációt.

Mi az a Google AI Studio?

A nagy nyelvi modellek (LLM-ek) ma már a modern szoftverek alapjai: segítenek a kódolásban, adatfeldolgozásban és tartalomgyártásban. Korábban több API-t és fejlesztői környezetet kellett összehangolni, csak hogy egyetlen promptot kipróbáljunk.

A Google AI Studio ezt a folyamatot egyszerűsíti. Egy webalapú munkafelület, ahol a legújabb Gemini modellekkel lehet promptokat írni, kimeneteket elemezni, majd működő kódot exportálni. A felület fejlesztőknek, designereknek és kutatóknak is ideális, akik ugyanabban a térben akarnak gondolkodni és tesztelni.

Fiók létrehozása és API-kulcs beállítása

Mielőtt a modelleket kipróbálnád, szükség van Google-fiókra és néhány alaplépésre.

- Jelentkezés az AI Studio-ba

- Nyisd meg a aistudio.google.com oldalt, és jelentkezz be Google-fiókkal. A felület teljesen böngészőben működik, telepítés nélkül.

- Adatvédelmi feltételek elfogadása

- Első használatkor el kell fogadni a Google AI Labs adatvédelmi és felhasználási feltételeit. Ez egyszeri lépés, amely engedélyezi, hogy az AI Studio hozzáférjen a projektekhez és mentse a promptok előzményeit.

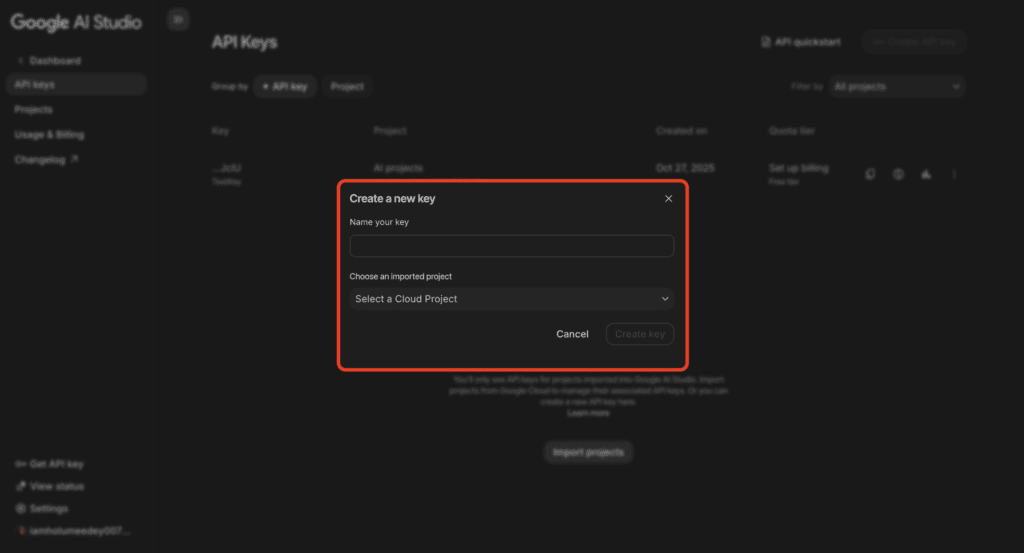

- API-kulcs létrehozása

- A bal oldali menüben válaszd az API Keys fület, majd kattints a Create API Key gombra. Nevezd el, rendeld egy projekthez, és másold ki a generált kulcsot. Ugyanez a kulcs használható Pythonban, Node.js-ben vagy cURL-ben.

Python példa:

from google import genai

client = genai.Client()

response = client.models.generate_content(

model="gemini-2.5-flash",

contents="Explain how AI works in a few words",

)

print(response.text)Node.js példa:

import { GoogleGenAI } from "@google/genai";

const ai = new GoogleGenAI({});

async function main() {

const response = await ai.models.generateContent({

model: "gemini-2.5-flash",

contents: "Explain how AI works in a few words",

});

console.log(response.text);

}

await main();Az AI Studio felületének áttekintése

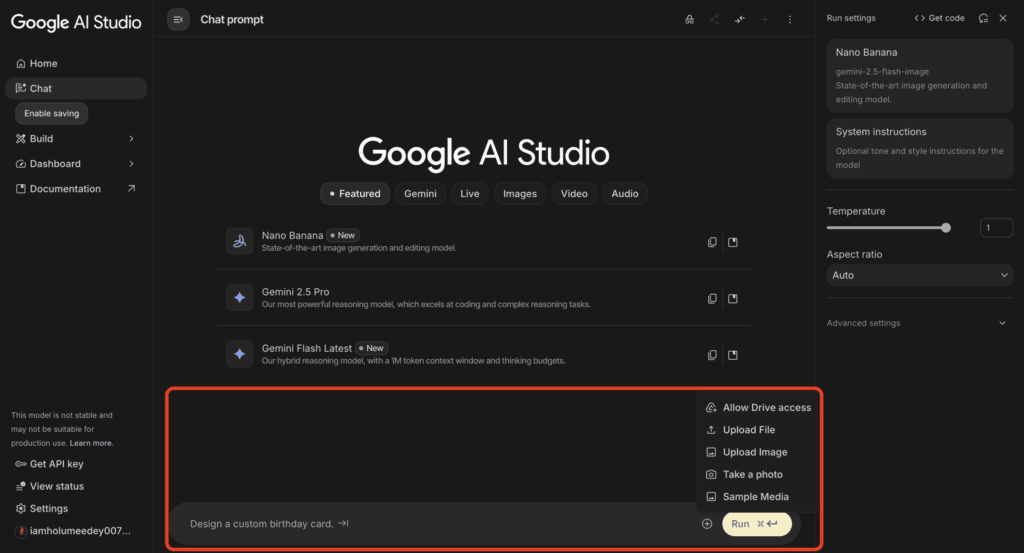

A Google AI Studio felülete interaktív és átlátható: minden funkció egy helyen elérhető, a promptolástól a kódexportig.

Új beszélgetés indítása (+ ikon)

Teljesen új „session” létrehozása, korábbi adatok nélkül.

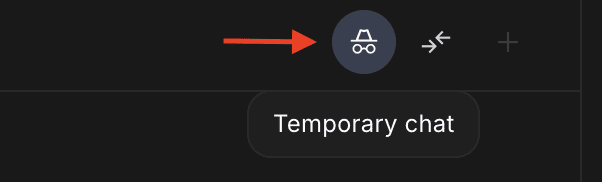

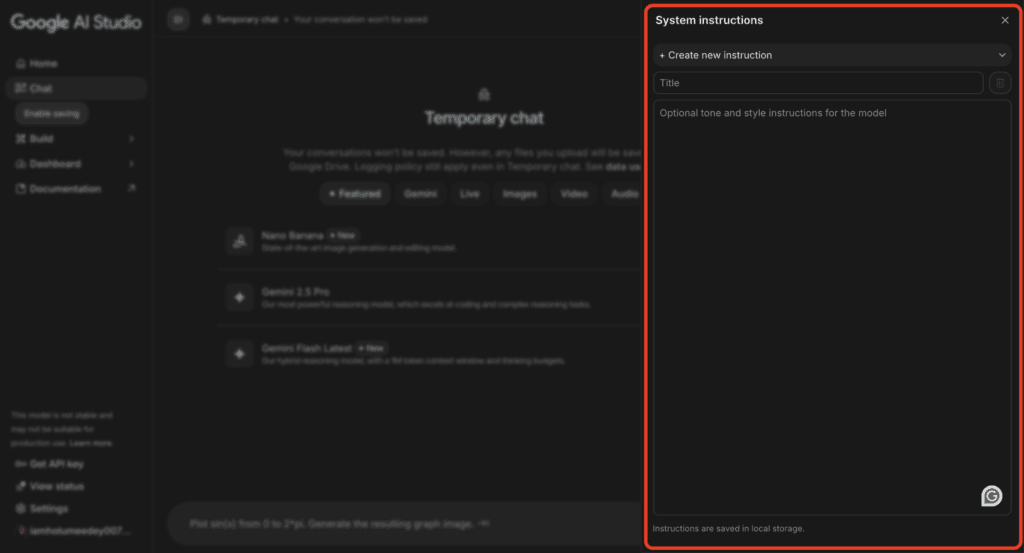

Ideiglenes beszélgetés (Temporary Chat)

Mentés nélküli beszélgetés, ahol a feltöltött fájlok a Google Drive-ban tárolódnak.

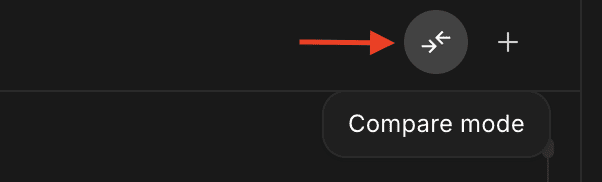

Összehasonlító mód (Compare Mode)

Különböző modellek válaszainak párhuzamos megjelenítése, A/B tesztekhez és minőségellenőrzéshez.

Kódgenerálás gomb (Get Code)

A prompt eredményét exportálja működő kódként, például Pythonban.

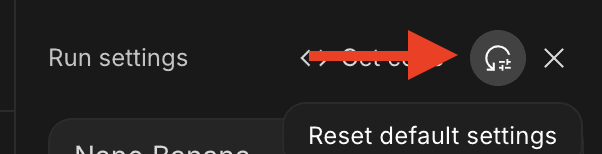

Beállítások visszaállítása (Reset Default Settings)

Visszaállítja a modellparamétereket (Temperature, Top P, Max Tokens stb.) az alapértékekre.

Prompt szerkesztő (Prompt Editor)

Fő beviteli mező, amely támogatja a többmenetes párbeszédet, fájlfeltöltést és multimédiás elemeket.

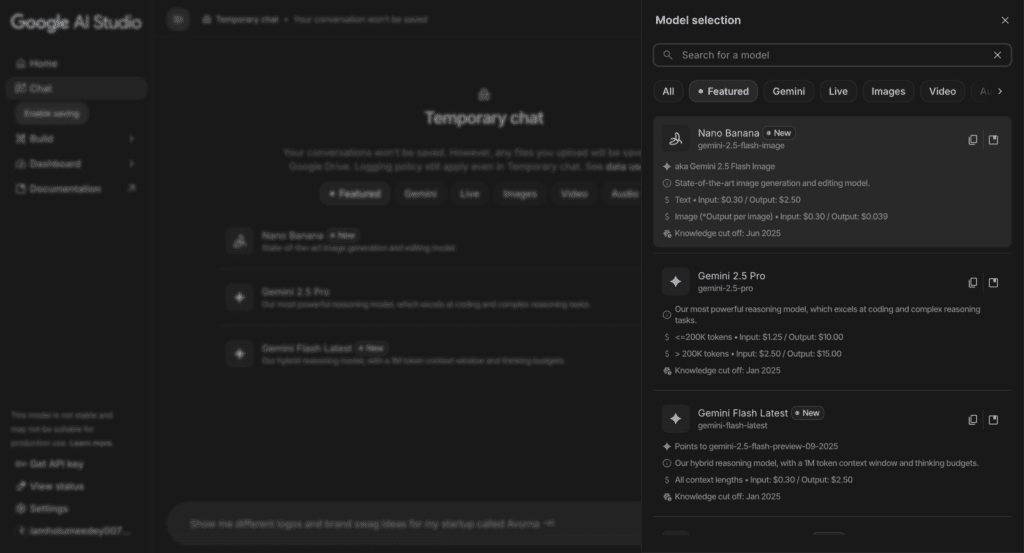

Modellválasztó (Model Selector)

A jobb felső sarokban található, ahol kiválasztható a használt modell (Gemini, Gemma, Images stb.).

Rendszerutasítások (System Instructions)

Globális irányelvek vagy szerepek megadása a modell számára, például:

- „Te egy segítőkész kódasszisztens vagy.”

- „Mindig pontokba szedve válaszolj.”

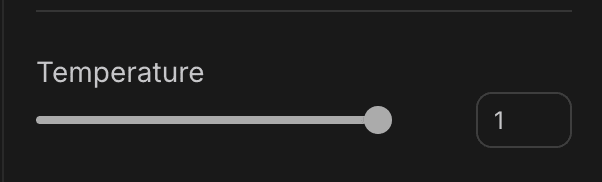

Hőmérséklet (Temperature)

A válaszok változatosságát befolyásolja: alacsony érték precízebb, magasabb kreatívabb válaszokat ad.

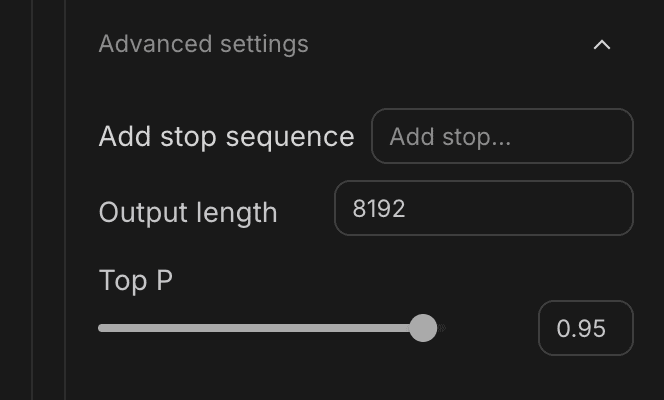

Haladó beállítások (Advanced Settings)

A „Haladó beállítások” (Advanced Settings) terület a modell kimenetét szabályozó finomhangolási paramétereket tartalmazza. Itt adható meg, meddig, hogyan és milyen stílusban generáljon szöveget a modell. A három legfontosabb beállítás: Stop Sequence, Output Length (Max Output Tokens) és Top P (Nucleus Sampling).

Stop Sequence: a válasz leállításának feltétele

A Stop Sequence olyan karaktersorozat vagy szó, amely megjelenésekor a modell azonnal befejezi a választ. Ez azért hasznos, mert:

- Lezárhatod a válasz hosszát természetes ponton (például bekezdés vagy lista után).

- Elkerülheted a felesleges ismétlést vagy a témától való eltérést.

- Használhatod formátumkorlátozáshoz (például ha csak a JSON végét akarod megkapni, vagy csak egy táblázatot).

Példák:

\n\n– a modell két sortörés után álljon le (egy bekezdésnyi válaszra).END– a modell addig generáljon, amíg el nem éri ezt a szót.</response>– XML vagy HTML-szerű formátum lezárásához.

Output Length (Max Output Tokens): a válasz maximális hossza

A Max Output Tokens megadja, hány tokenig (szó vagy szóelem) engedjük a modellt válaszolni.

A tokenek nem mindig felelnek meg egy szónak: egy angol szó átlagosan 1–1,5 token.

Mit befolyásol?

- A válasz részletességét és hosszát.

- A válasz időtartamát és költségét, mivel a legtöbb API token alapon számláz.

- Ha túl rövidre állítod, a válasz levágódhat; ha túl hosszúra, a modell feleslegesen „bőbeszédű” lesz.

Irányelvek:

- Rövid válaszokhoz (pl. összefoglalók, bulletpontok): 100–300 token.

- Normál szövegekhez (pl. cikkrészletek, elemzések): 500–1000 token.

- Hosszabb generáláshoz (pl. történetek, kódgenerálás): 1500–3000 token.

Top P (Nucleus Sampling): a kimenet valószínűségi „takarítása”

A Top P beállítás egy valószínűségi küszöböt ad meg (0–1 között), amely szabályozza, milyen „merészen” választ szavakat a modell a következő lépésben.

Ahelyett, hogy minden lehetséges szóból választana (mint a Temperature esetében), a Top P csak a legvalószínűbb szavakat veszi figyelembe, amíg azok összesített valószínűsége el nem éri a P értéket. Ezután csak ebből a szűkített halmazból választ.

Példák:

- Top P = 1.0 → a modell bármilyen szót választhat, nagy kreativitás, több hiba.

- Top P = 0.9 → a modell csak a 90%-nyi legvalószínűbb szavak közül választ, kiegyensúlyozott.

- Top P = 0.5 → a modell a legvalószínűbb fele szóból választ; sokkal kiszámíthatóbb, formálisabb válasz.

Top P és Temperature együtt:

Mindkét érték a válasz véletlenszerűségét szabályozza, de más logikával:

- A Temperature minden szó valószínűségét „laposítja” vagy „meredekké” teszi, így befolyásolja az eloszlást.

- A Top P levágja a ritkább szavakat a lista végéről, kizárva az extrém választásokat.

Ajánlás:

- Ha kreatív írásra vagy brainstormingra használsz modellt → Temperature 0.8–1.0, Top P 0.9–1.0

- Ha adatfeldolgozásra vagy strukturált válaszra → Temperature 0.2–0.5, Top P 0.7–0.9

Összefoglalva: a három beállítás együttműködése

| Beállítás | Fő hatás | Tipikus értéktartomány | Mikor érdemes állítani |

|---|---|---|---|

| Stop Sequence | A válasz leállítási pontja | karakterlánc (pl. \n\n, END) | Ha csak részválasz kell vagy strukturált kimenet |

| Output Length | A válasz maximális hossza | 100–3000 token | Ha rövidebb vagy hosszabb válasz szükséges |

| Top P | Szókiválasztási valószínűség | 0.5–1.0 | Kreativitás vagy formalitás szabályozásához |

Válaszpanel (Response Panel)

Megjeleníti a modell kimenetét és a válaszhoz tartozó metaadatokat.

Modellek és verziók kiválasztása

A modellnevekben szerepelhet verziószám (pl. 2.5), szint (Flash, Pro, Ultra), valamint „latest” vagy „Lite” jelölés.

- Gemini Flash – gyors, költséghatékony, rövid válaszidő, valós idejű alkalmazásokhoz.

- Gemini Pro – nagyobb teljesítmény, összetettebb feladatokra.

- Gemini Ultra – fejlett multimodális és kutatási célokra.

- Code Models – kódgenerálásra és hibakeresésre.

- Embedding Models – keresésre, ajánlásra és szemantikus lekérdezésekre.

| Modell | Kontextus | Késleltetés | Ideális felhasználás |

|---|---|---|---|

| Gemini 2.5 Flash | Magas (128K) | Nagyon alacsony | Valós idejű appok, chat, összegzés |

| Gemini 2.5 Flash latest | Magas (128K+) | Nagyon alacsony | Frissített, optimalizált változat |

| Gemini 2.5 Flash-Lite latest | Magas (128K) | Rendkívül alacsony | Gyors válaszok, kis erőforrás |

| Gemini 2.5 Pro | Nagyon magas (256K+) | Közepes | Összetett feladatok, kód, adat |

| Gemini 2.5 Pro latest | Nagyon magas (256K+) | Közepes | Legújabb fejlesztés |

| Gemini Ultra | Ultra magas (1M+) | Magas | Multimodális, kutatási cél |

| Code Models | Változó | Alacsony–közepes | Kódgenerálás |

| Embedding Models | Változó | Nagyon alacsony | Keresés, ajánlás |

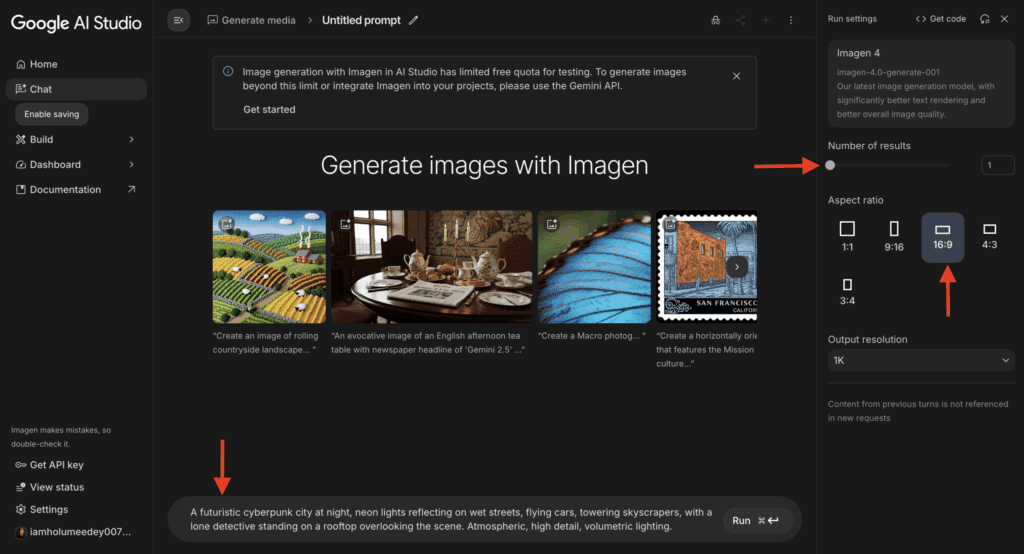

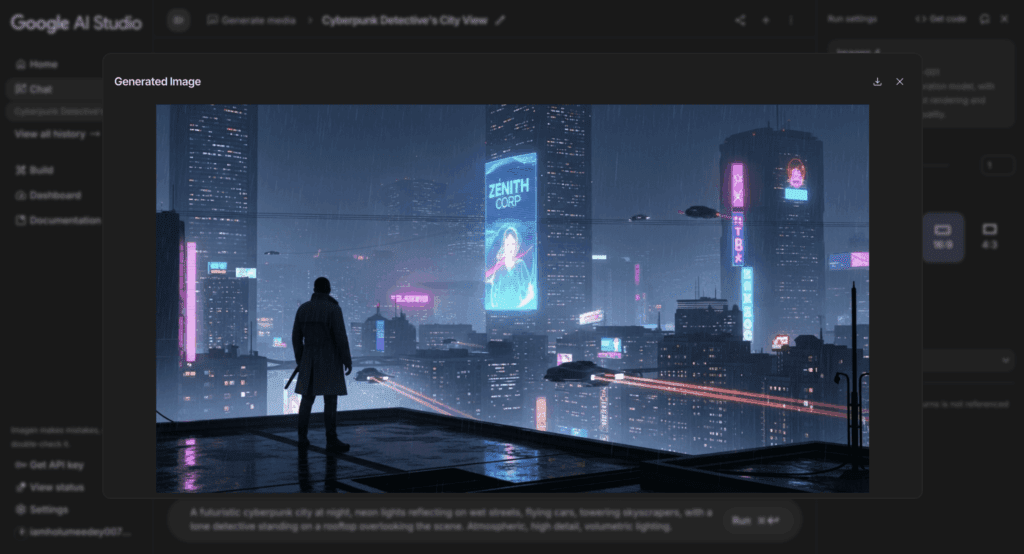

Képgenerálás és szerkesztés az AI Studio-ban

A Google AI Studio az Imagen és Gemini modellekre épít, amelyek szövegből képet hoznak létre, variációkat és szerkesztéseket is készítenek.

Prompt:

Cyberpunk város éjszaka, neonfény, repülő autók, felhőkarcolók, egy nyomozó a tetőn, aki a várost figyeli.Beállítások:

Model: Imagen 4

Képek száma: 1

Képarány: 16:9

Az eredmény:

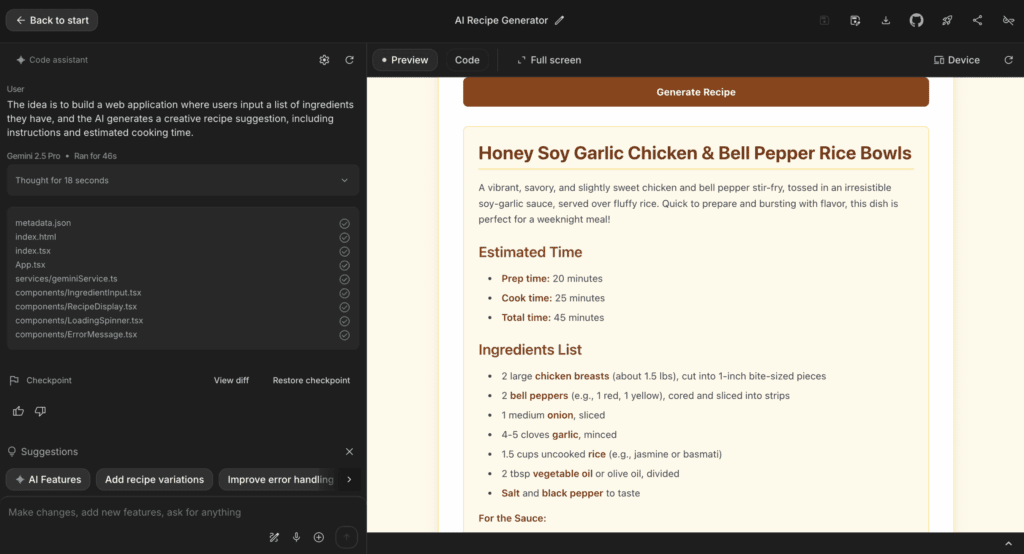

Alkalmazások készítése a Build funkcióval

A Build funkció segítségével egy működő prompt API-végponttá alakítható, integrációs kód generálható, és akár webes alkalmazásként is publikálható.

Példa: Smart Recipe Generator

Felhasználó megadja az alapanyagokat, az MI pedig receptet generál hozzávalókkal, lépésekkel és főzési idővel.

Beállítások:

Model: Gemini-2.5 Pro

System instructions: „Te egy kreatív séf asszisztense vagy…”

Prompt példa:

Input: „chicken breast, bell peppers, onions, rice, soy sauce, garlic”

Output:

- Recipe Name

- Ingredients

- Instructions

- Cooking Time

Az AI Studio szerepe a fejlesztésben

A Google AI Studio megkönnyíti a nyelvi modellekkel való munkát, és új szintre emeli a kísérletezést. A gyors prototipizálás, a rugalmas modellválasztás és a Vertex AI-integráció lehetővé teszi, hogy a fejlesztők néhány kattintással valós alkalmazásokat készítsenek.